Post 8: Los modelos de IA son cada vez más grandes 💸

Published:

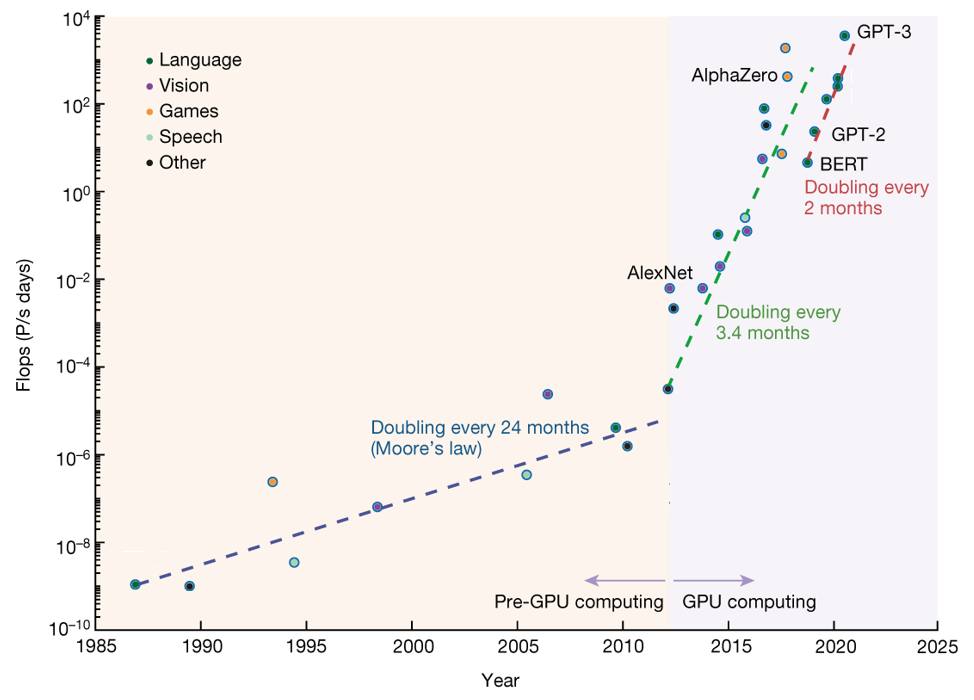

La inteligencia artificial no existiría sin tarjetas gráficas (Graphics Processing Units, GPUs). Aunque originalmente fueron pensadas para videojuegos y multimedia, ahora son usadas para modelar proteínas y lenguajes. Antes de ellas, la computación con procesadores estableció la “Ley de Moore”, que sugiere que cada 2 años doblamos la capacidad de cómputo. Sin embargo, en 2012 la IA AlexNet provocó una avalancha de la comunidad científica al uso de GPUs, y ahora la capacidad de computo se dobla cada 6 meses, lo cual ha llevado a sugerir una “nueva ley” conocida como la “Ley de Huang”. Si bien ambas no son realmente leyes pues son fenómenos de mercado, es interesante ver como crece nuestra capacidad de procesar datos.

Acá dos artículos para entender estas tendencias:

- Compute Trends Across Three Eras of Machine Learning

- Dendrocentric learning for synthetic intelligence

Y dos vidios: